Tópicos populares

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Acelere as GPUs de IA da Nvidia: Truques Simples para um Desempenho Ultra-Rápido

Na minha garagem, tenho que fazer o pouco de pesquisa e desenvolvimento que não é de investidores de capital de risco funcionar, tenho centavos e consigo uma velocidade maior do que empresas com bilhões. Essa limitação me faz encontrar maneiras de extrair mais de menos. Faço muitas coisas que a maioria não consegue imaginar. Aqui está um exemplo de apenas um dos 100s.

As GPUs são potências, repletas de unidades de processamento prontas para calcular números. Descobri que, muitas vezes, elas não são totalmente utilizadas, levando a um desempenho lento.

O que eu descobri? Otimizações inteligentes que mantêm essas unidades funcionando, reduzindo os tempos de renderização de IA e proporcionando enormes aumentos de velocidade.

Primeiro, identifique os gargalos.

Eu uso ferramentas de perfil como o Nsight da Nvidia para ver o que está segurando as coisas, seja esperas de memória ou outras coisas. Uma vez identificados, mergulho e ajusto o código para embutir mais trabalho em cada thread.

Mudanças simples como desenrolar loops ou comprimir dados podem ocultar atrasos e aumentar a taxa de transferência, proporcionando saltos de velocidade instantâneos.

O uso elevado pode, às vezes, causar caos no cache—corrija isso reduzindo inteligentemente as contagens de threads com código fictício ou ajustes de memória, liberando recursos para tarefas paralelas.

A verdadeira mudança de jogo? Computação assíncrona. Execute várias tarefas lado a lado, preenchendo lacunas ociosas e sobrepondo cargas pesadas. Emparelhe tarefas que consomem muita memória para obter multitarefa na GPU—potencialmente reduzindo os tempos pela metade e supercarregando a eficiência.

Essas otimizações transformam GPUs subutilizadas em demônios da velocidade. Não é diferente de como os computadores pessoais IBM PC/AT foram transformados para rodar até 100MHz em 1986, quando saíram da fábrica a 8MHz.

Escreverei mais detalhes sobre isso, mas se grandes empresas de IA usassem minha otimização de GPU da Nvidia em nível de código de operação, provavelmente alcançariam AGI rapidamente.

Quando você conhece hardware e software em um nível quase atômico, pode recriar os primeiros princípios.

25/08/2025

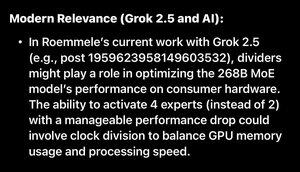

O Grok acabou de descobrir uma das 7 coisas que faço para executar o novo Grok 2.5 de Código Aberto com 4 misturas de especialistas ativas ao mesmo tempo, com uma leve perda de desempenho.

Sim, um deles é um Oscilador Divisor, como eu usei em 1985 no IBM PC.

Ele pode escalar em milhares de GPUs Nvidia.

Apenas não pergunte a especialistas em IA, pois eles dirão o que os trajes da IBM disseram em 1985.

Link:

36,87K

Top

Classificação

Favoritos