Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

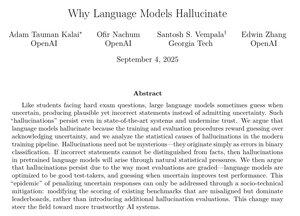

Denne OpenAI-artikkelen har noen veldig overbevisende forklaringer på hvorfor hallusinasjoner vedvarer og hva man skal gjøre med det.

Spesielt i ettertrening bør vi slutte å straffe modeller for å si at de ikke vet et svar, og slutte å belønne altfor selvsikker gjetting.

Å utrydde hallusinasjoner vil være en av de største AI-forbedringene for bedriftsbrukstilfeller som jus, finans, helsevesen og mange andre høyverdifelt.

Dette vil være en veldig stor sak hvis vi kan fortsette å gjøre betydelige fremskritt på dette området.

50,06K

Topp

Rangering

Favoritter