Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

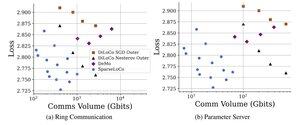

Añadir retroalimentación de error top-k y eliminar Nesterov externo de DiloCo (así que ~SGD plano externo).

Todavía estoy bastante sorprendido de que funcione / podría reemplazar a Nesterov :0

¡Buen trabajo!

22 ago, 10:13

Presentamos SparseLoCo: un método eficiente en comunicación para el preentrenamiento de LLM.

Resumen: Aprovechamos la esparsificación Top-k + retroalimentación de errores con los pasos externos infrecuentes de DiLoCo—comunicando solo el 1–3% de los gradientes con cuantización de 2 bits—superando a DiLoCo y DeMo. 1/N,

ArXiv:

Github:

5,01K

Parte superior

Clasificación

Favoritos