Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Você não pode construir produtos de IA como outros produtos.

Os produtos de IA são inerentemente não determinísticos e você precisa negociar constantemente a troca entre agência e controle.

Quando as equipes não reconhecem essas diferenças, seus produtos enfrentam falhas inesperadas, ficam presos na depuração de sistemas grandes e complicados que não conseguem rastrear e a confiança do usuário no produto diminui silenciosamente.

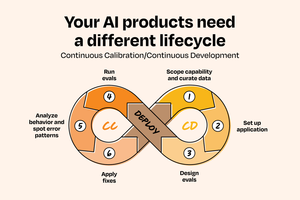

Depois de ver esse padrão acontecer em 50+ implementações de IA em empresas como @OpenAI, @Google, @Amazon e @Databricks, Aishwarya Naresh Reganti e Kiriti Badam desenvolveram uma solução: a estrutura de Calibração Contínua/Desenvolvimento Contínuo (CC/CD).

O nome é uma referência a CI/CD (Integração Contínua/Implantação Contínua), mas, ao contrário de seu homônimo, destina-se a sistemas em que o comportamento não é determinístico e a agência precisa ser conquistada.

Esta estrutura mostra como:

- Comece com recursos de alto controle e baixa agência

- Crie sistemas de avaliação que realmente funcionem

- Dimensione produtos de IA sem quebrar a confiança do usuário

Ele foi projetado para reconhecer a singularidade dos sistemas de IA e ajudá-lo a criar produtos de IA mais intencionais, estáveis e confiáveis.

Eles estão compartilhando publicamente pela primeira vez:

113,83K

Melhores

Classificação

Favoritos